Bizga O'zbekiston bozorining yetakchilari ishonishadi

NVIDIA DGX B200 — yangi avlodning eng kuchli AI platformasi asosidagi GPUaaS. O'zbekistonning suveren bulutida LLMlarni o'qiting, inferensni ishga tushiring va HPC vazifalarini hal qiling.

Bizga O'zbekiston bozorining yetakchilari ishonishadi

Korporativ modellarni qo'shimcha o'qitish, SFT, LoRA/QLoRA, bir nechta GPUda taqsimlangan o'qitish.

LLM va multimodal modellarni ishga tushirish, korporativ AI-xizmatlari, agentlar va low-latency inferens.

CV, OCR, speech, video tahlil, katta datasetlar bilan ishlash va tezlashtirilgan inferens.

Sonli modellashtirish, CUDA ilovalari, parallel hisoblashlar va resurs talab qiladigan tadqiqot vazifalari.

Modellarni o'qitish va qo'shimcha o'qitish, LLMlar bilan tajribalar, vazifalarni 1 ta GPUdan multi-GPU va multi-node konfiguratsiyalarigacha kengaytirish.

Ma'lumotlar, modellar va payplaynlar O'zbekistonning mahalliy konturida qoladi — nozik ma'lumotlarni tashqi bulutlarga chiqarmasdan.

Resurs talab qiladigan hisob-kitoblar, tadqiqotlar, productiondagi inferens va prognoz qilinadigan unumdorlikka ega AI-xizmatlarini ishga tushirish uchun.

H100 va H200 asoslangan Hopperdan keyingi avlod. Enterprise darajasidagi AI-modellarni o'qitish, fine-tuning va inferens qilish uchun eng zamonaviy platforma.

Muayyan vazifa uchun resurslarni ajrating: alohida GPUlardan tortib, taqsimlangan o'qitish va production yuklamalar uchun multi-GPU va multi-node konfiguratsiyalarigacha.

Infratuzilma mahalliy darajada joylashgan: past kechikishlar, ma'lumotlar bilan tezroq ishlash va nozik ma'lumotlarni joylashtirish talablariga muvofiqlik.

CUDA ekotizimi, NVIDIA NGC, PyTorch, TensorFlow, Docker konteynerlari va mashhur MLOps ssenariylarini uzoq vaqt qo'lda sozlamasdan qo'llab-quvvatlash.

Datasetlar, model vaznlari va hisoblash natijalari mahalliy konturda qoladi — bu enterprise, fintex va tartibga solinadigan sohalar uchun muhim.

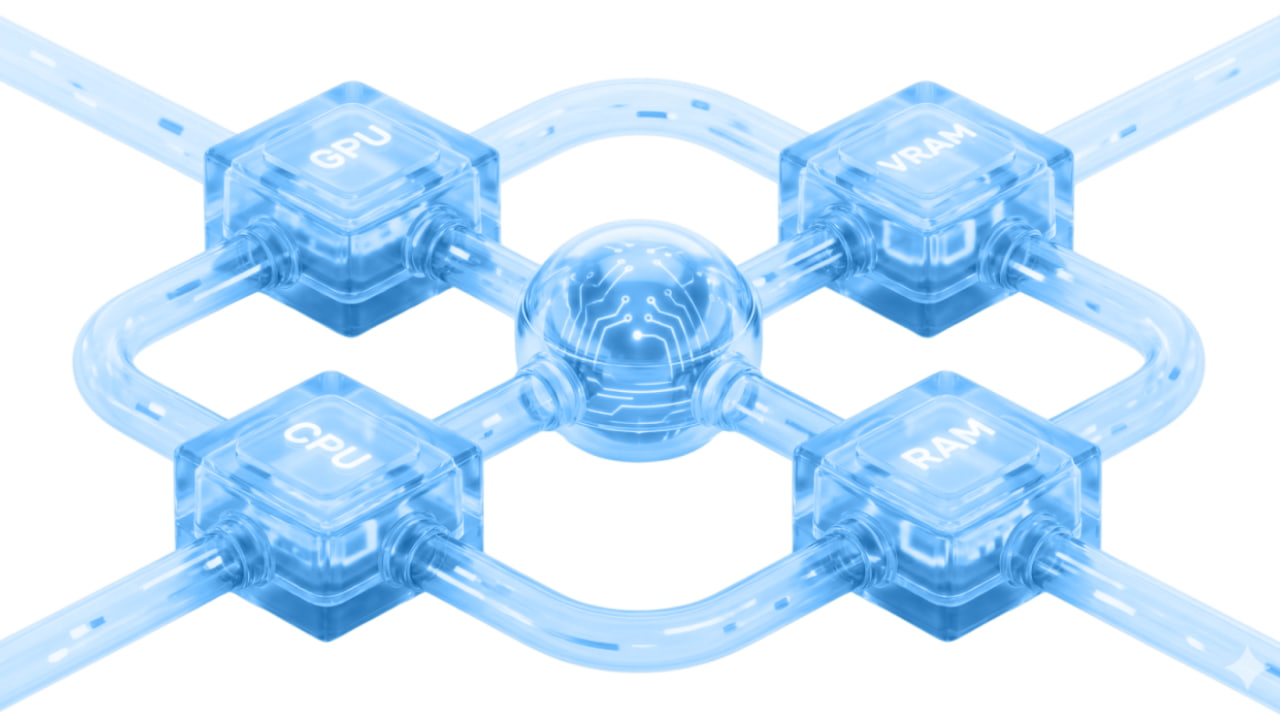

Tugun ichidagi GPUlar va klaster tugunlari o'rtasidagi tezkor ma'lumot almashinuvi distributed training va og'ir inferensni samaraliroq ishga tushirishga yordam beradi.

Xizmatda DGX platformasidagi NVIDIA Blackwell B200 asosidagi hisoblash resurslari mavjud. Konfiguratsiyalar vazifaga qarab tanlanadi: bitta GPUdan tortib multi-GPU va klaster ssenariylarigacha.

B200 Blackwell arxitekturasida qurilgan — bu H100 va H200 asoslangan Hopperdan keyingi avlod. AI va LLM yuklamalari uchun bu GPUda katta hajmli xotiraga ega va keng ko'lamli GenAI ssenariylariga yaxshiroq tayyor bo'lgan zamonaviyroq platformadir.

Kirish Run:ai platformasi asosidagi API-endpointlar orqali ta'minlanadi. Siz endpoint olasiz, u orqali konteynerlarni joylashtirasiz va yuklamani boshqarasiz — serverlarni qo'lda sozlamasdan.

Ha. Taqsimlangan o'qitish, inferens va HPC vazifalari uchun 1 ta GPUdan multi-GPU va multi-node ssenariylarigacha bo'lgan konfiguratsiyalarni qo'llab-quvvatlaymiz. Kengaytirish Run:ai orqali boshqariladi — har bir so'rovda bizning jamoamiz ishtirokisiz.

Infratuzilma O'zbekistonda joylashgan. Bu ma'lumotlarni saqlashning mahalliy konturini va mamlakat ichidagi foydalanuvchilar uchun minimal kechikishlarni ta'minlaydi.

Infratuzilma Run:ai asosida ishlaydi — siz endpoint olasiz va konteynerlarni mustaqil ravishda joylashtirasiz. PyTorch, TensorFlow, vLLM standart obrazlari va maxsus Docker konteynerlari qo'llab-quvvatlanadi. Zarur bo'lganda, bizning jamoamiz onbording va birinchi marta ishga tushirishda yordam beradi.

Arxitektorning bepul tahlili: migratsiya rejasini tuzamiz va ortiqcha xarajatlarni kesamiz.